Tag 1 – 05.03.2023:

Die Anreise aus Deutschland funktioniert dieses Mal recht gut. Wir mussten allerdings trotz Lufthansa Flug zum Egypt Air Schalter. Am Flughafen konnte man das aber nicht sehen, da aufgrund der Masse der Flüge nur die nächsten 90 Minuten angezeigt wurden. Somit hatte ich Glück, dass ich mich am Vorabend für den Benachrichtigungen für den Flug registriert hatte, da ein Check In über Lufthansa auch nicht möglich war. Wie ich dann herausgefunden habe, funktioniert der Egypt Air Checkin aktuell von Frankfurt aus generell nicht.

Der Mitarbeiter am Schalter hat nur verpennt uns die Flugtickets zu geben, somit hatten wir eine kleine Ehrenrunde (dabei hab ich ihn noch gefragt, ob er mit allem fertig ist). Ansonsten hat er uns noch erzählt, dass wir Passfotos machen müssen für das Visum (was Quatsch ist, das braucht man nur, wenn man keinen Reisepass dabei hat und stattdessen mit dem Personalausweis einreist). Beim Sicherheitscheck war die Wartezeit am Frankfurter Flughafen nicht vorhanden, so habe ich das in Frankfurt noch nie erlebt.

Der Flug ging ca. 30 Minuten später los, war aber pünktlich am Zielort (das war am Vortag auch schon so, scheint also nicht ungewöhnlich zu sein). Das Visum ist recht einfach zu bekommen. Das wichtigste ist Bargeld, Euros oder Dollar. Wenn man (bei uns ca. 25 €) bezahlt hat, kommt man ohne Probleme nach Ägypten rein. Die einzige Frage der Einreise(beamtin?) war die nach dem Herkunftsflughafen.

Am längsten ist die Wartezeit auf die Koffer und die Strecke zum Hotel dauert auch noch mal 45 Minuten im Kairoer Abendverkehr. Die Straßenverhältnisse sind für Europäer chaotisch. Jeder fährt wie er meint und Ampeln gibt es nicht oder sie sind inaktiv. Die Fußgänger wuseln in dem Chaos irgendwann auch noch dazwischen rum aber irgendwie funktioniert es.

Im Hotel sind wir nach ca. 22:30.

Nachts lernen wir noch, dass es in Ägypten nachaktive Vögel gibt, die einen Höllenlärm machen. General gilt in Ägypten, dass man einen guten Schlaf haben sollten. Die Gebete, starten je nach Region um 4:30 und sind unterschiedliche ausufernd und je nach Lautsprecherpositionen sehr laut auch im Hotelzimmer. Gehupt wir zu jeder Tageszeit, auch nachts (allerdings etwas weniger). Und am Freitag ist bei diesem Hotel auch noch ein Partybus unterwegs, der einen Regelmäßig weckt. Verschlafen ist also in Ägypten fast unmöglich. Der Hahn, der sich morgens meldet, fällt eher angenehm leise auf.

Tag 2 – 06.03.2023:

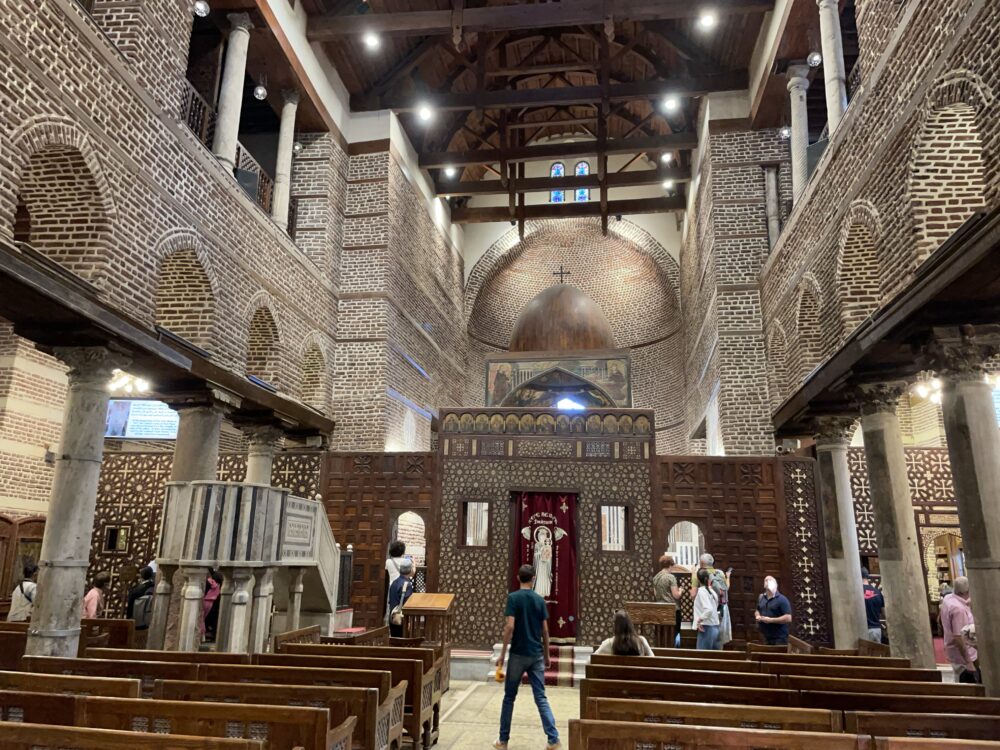

Heute geht es um 7:30 los und wir besichtigen diverse Sehenswürdigkeiten in Kairo. Los geht es mit mehreren Moscheen wie zum Beispiel der Alabaster Moschee, Sultan Hassan und El-Din (Zitadelle von Saladin). Später besichtigen wir das klassische Ägyptische Museum (das neue hat noch nicht eröffnet, angebliche Eröffnung 2023 aber die Bauzeit beträgt jetzt schon über 20 Jahre) und die hängende Kirche und eine andere Kirche im koptischen Viertel. Das Ägyptische Museum um die Mittagszeit zu besuchen ist übrigens eine gute Idee, denn morgens ist es extrem überlaufen (siehe unten).

Beim Essen abends im Hotel merkt man wie Ägypten Preisgestaltung geht – vier Getränke 300 Pfund was knapp 10€ entspricht. Für europäische Verhältnisse ist das ok, für ägyptische eher dreist. Diese Art Wegelagerei trifft man in Ägypten aber häufig an. Die Einheimischen zahlen oft nur einen Bruchteil und oft ist der Preis gemessen an dem gebotenen reichlich überzogen.

Der Reiseleiter sammelt direkt Trinkgeld 5€ pro Person pro Tag – 70€ für die Tour mal 16 Leute (Umrechnungsfaktor 32, eine Pizza kostet in Ägypten somit ca. 1,5€ um das ins Verhältnis zu setzen – das ist also sehr viel Trinkgeld). Angeblich wird das Trinkgeld für alle ausgegeben, mit denen wir direkt in Kontakt sind.

Das betrifft bei Sehenswürdigkeiten die Leute, die irgendwo sitzen, Tore bewachen, Polizei, Hotelpersonal, Kofferträger, Zimmermädchen usw. – faktisch kann mir aber keiner erzählen, dass so viel Trinkgeld wirklich bei all den Leuten ankommt, die mit uns Kontakt haben. Ich denke das der Rest (wie hoch auch immer der ist) beim Tourguide landet.

Tag 3 – 07.03.2023:

Heute geht es schon um 7:00 los, um Alexandria zu besichtigen. Am Morgen machen wir einen Zwischenstopp im Kloster des heiligen Makarios (mein Eindruck, Kloster sind überall dort, wo natürliche Wasserquellen in der Nähe sind und die vermeintlich Heiligen sind einfach die Gründer der Kloster).

Auf der Tour besuchen wir mehrere Kloster. Die Koster haben alle um die 100-120 Mönche und offenbar auch keine Nachwuchsprobleme. Die Kloster haben unterschiedliche Einnahmequellen (Farmen, Besitztümer, Touristen) und die Sache rechnet sich offenbar ganz gut.

In Alexandria haben wir zuerst Gräber (Kom el Shoqafa) besucht, danach Pompey’s Pillar und zuletzt das Alexandria National Museum. Die Bibliothek stand nicht auf unserer Liste.

Bzgl. des Straßenverkehrs konnte man heute wieder einiges lernen. Rückwärts fahren auf der Autobahn und die Nutzung der Autobahn durch Fußgänger sind in Ägypten kein Problem.

Heute haben wir zum ersten Mal Polizeibegleitung im Bus (das sind Leute in Anzügen, die unter dem Jackett eine Waffe, z.B. Maschinenpistole mit Ersatzmagazinen tragen). Braucht man diesen Schutz? Keineswegs. Je nach Lust und Laune der Behörden ist es in einigen Regionen aber Vorschrift. Der einzige Schutz den man Braucht ist ggf. der vor den ganzen Händlern. 😉

Tag 4 – 08.03.2023:

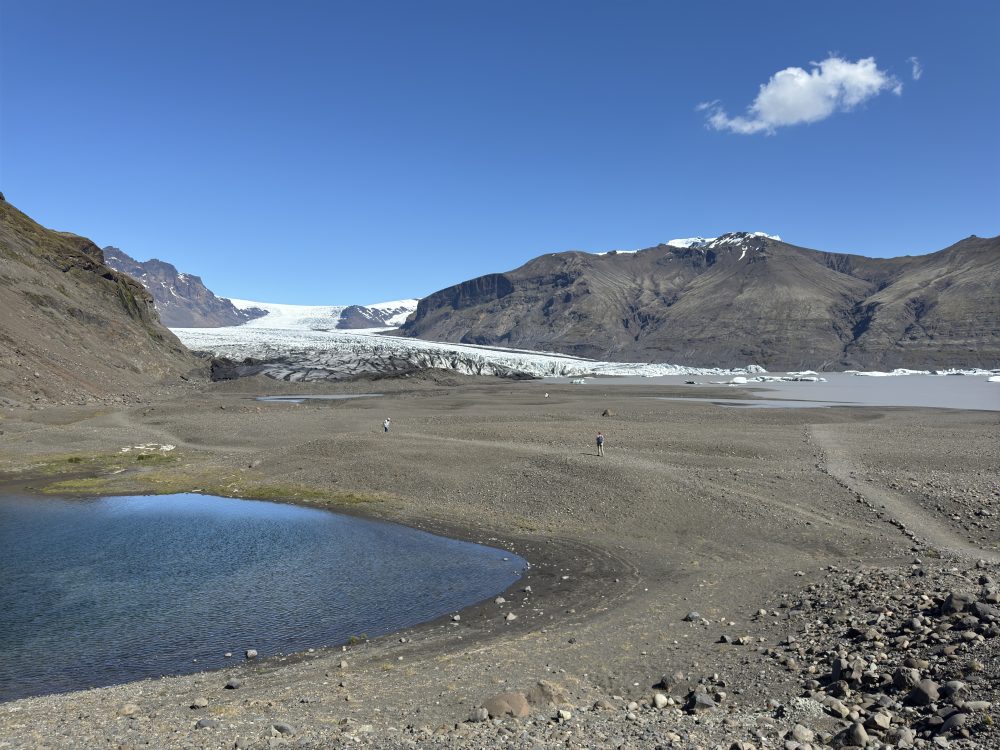

Heute geht es wieder um 7:30 los. Zuerst besuchen wir die Stufenpyramide von Saqqara und anschließend das Freilichtmuseum von Memphis, wo sich eine große Statue vom Ramses befindet.

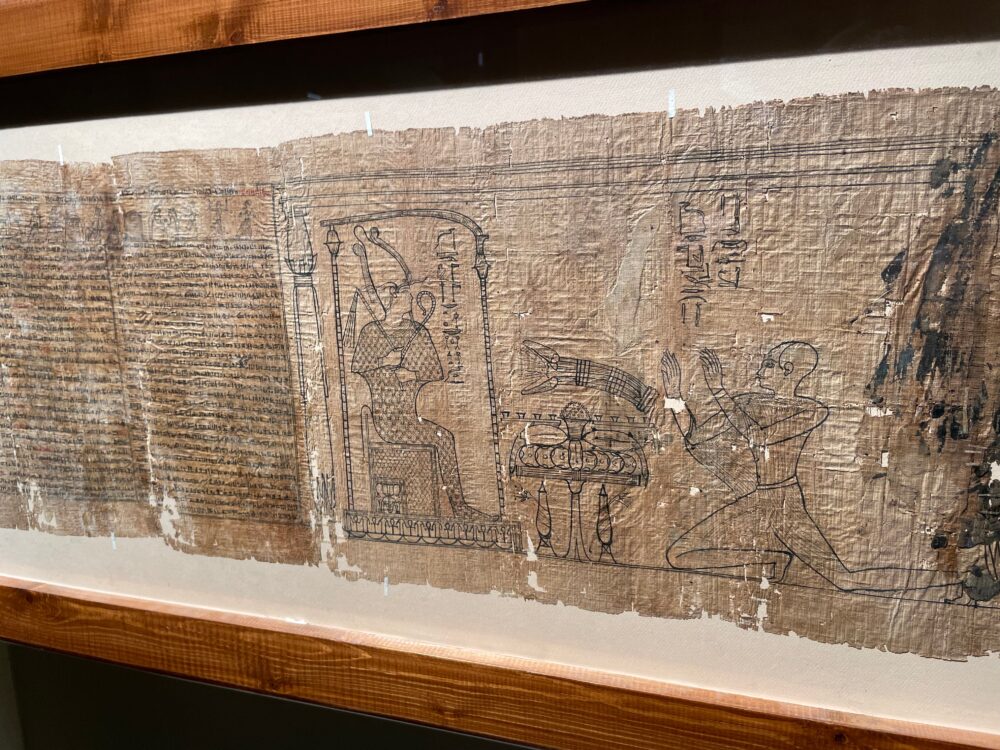

Danach geht es zum Mittagessen und zu den Pyramiden von Gizeh und der Sphinx. Anschließend gibt es noch eine Mischung aus Verkaufsshow und Erklärung in einer Parfümerie (diese Art Shows bekommen wir im Laufe der Reise noch mehrere für Papyrus und auch für Steingut).

Tag 5 – 09.03.2023:

Heute geht es nach El Minia. Die Nacht ist leider wegen ordentliche Durchfall früh (um ca. 1:00) vorbei. Ich weiß nicht, ob es der Fluch des Pharaos ist, einfach meine typischen Magenprobleme oder eine Magen-Darm Erkrankung. Faktisch wird mich das Thema aber die ganze Tour über verfolgen und auch noch danach.

Heute bekommen wir neben der Begleitperson im Bus noch einen Streifenwagen als Eskorte. So langsam fühlen wir uns wichtig.

Die Highlights sind heute überschaubar. Wir besichtigen Tuna el-Gebel.

Es ist erstaunlich wie zugemüllt Ägypten ist. Plastikmüll findet sich in rauen Mengen um die Sehenswürdigkeiten an Autobahnen oder an Flüssen (die lebensnotwendig sind). Es stört offenbar auch keinen Ägypter. Es laufen an den Attraktionen so viele überflüssige Sicherheitsleute rum aber auf die Idee mal Müll einzusammeln kommt offenbar niemand. Unsere Vermutung: So was wie Müllabfuhr gibt es in den nicht städtischen Regionen nicht oder es ist zu teuer, alles was man früher hatte, hat sich selbst zersetzt. Mit Plastikmüll funktioniert das nicht mehr und jeder kippt ihn irgendwo hin, wo er dauerhaft erhalten bleibt.

Tag 6 – 10.03.2023:

Heute ging es erst um 9:00 los und wir haben die Beni Hassan Tombs und El-Armana besucht. Beides wieder mit heftiger Polizeieskorte. Nicht, dass es nötig wäre aber es gibt viele Polizisten, die gerne ein Trinkgeld nehmen. Und aus erst einem Auto wurden immer mehr, weil man so etwas Trinkgeld bekommen kann.

Generell gilt, dass die ägyptische Landbevölkerung (vor allem die jungen Leute und davon noch mehr die Mädchen) sehr positiv auf den Touristenbus reagieren. Es prallen extreme Welten aufeinander. Aus unserer Sicht haben die Menschen sehr wenig, das ändert aber nicht ihren Enthusiasmus beim Winken und an der Freude, die sie zeigen.

Anfangs fand ich etwas seltsam als vermeintlich reicher Tourist in einem modernen Reisebus durch Dörfer zu fahren, die für uns eher anmuten wie aus ferner Vergangenheit. Aber die Ägypter winken zuerst und nicht zurück winken ist unhöflich und seltsam und gerade bei Kindern finde ich es auch ziemlich arschig die Freundlichkeit oder das Interesse nicht zu erwidern. Wenn man sich so einfach ein wenig annähern kann, ist das wohl der geringste Preis.

Auch wenn man diesbezüglich in Ägypten immer sehr vorsichtig sein muss, da sehr viele Ägypter Touristen nur als potenzielle Geldquelle betrachten. Das trifft auf die Landbevölkerung aber überhaupt nicht zu, da der Bus nur durch das Dorf hindurchfährt und eher stört als nutzt. D.h. die haben nichts zu erwarten, sind aber trotzdem freundlich.

Es gibt natürlich leider aber auch verständlicherweise viele Ägypter, die das schnelle Geld mit den Touristen machen wollen und Preise wie in Deutschland nehmen und sehr offensiv auf Touristen zugehen. Das sind die vielen Händler, schlimmer sind aber die Leute, die man überall in Ägypten trifft und die einen potenziell abzocken wollen.

Dabei fällt es einem als Tourist extrem schwer herauszufinden, ob die Leute nett sind oder einen gerade über den Tisch ziehen wollen. Beispiel: Man versucht in Ägypten eine Straße in Kairo zu queren. Das ist für Touristen schon Herausforderung genug. Ein freundlicher Ägypter hilft einem (so weit so gut), dann sucht der Ägypter das Gespräch. Ab hier wird es schwierig.

Im Gespräch sind fast immer irgendwelche Empfehlungen enthalten (Ihr solltet nicht hier laufen, sondern in den Teil von Kairo gehen, woraufhin derjenige energisch vorgeht und man folgen soll! Ihr wart im Museum? Die Tickets könnt ihr dort in der Nebengasse eintauschen und bekommt Geld zurück, gleich da vorne!, Ihr sucht ein Restaurant, dass dort zwei Straßen weiter ist sehr gut, da müsst ihr unbedingt hingehen).

Das Ergebnis ist oft, dass die Leute für ihre Leistungen anschließend Bezahlungen wollen oder ggf. auch schlimmeres. Ich hab sehr bewusst nicht probiert, was mich ein paar Straßen weiter erwartet. Man wird als Tourist auf jeden Fall sehr schnell skeptisch und vertraut sehr schnell niemanden mehr und blockt sehr schnell (das ist schade) und fördert den Austausch mit den Einheimischen überhaupt nicht.

Vermutlich ist das auch der Grund warum die Regierung die Touristen noch mehr von den Einheimischen abschotten will (siehe Neues Museum mit Seilbahn zu den Pyramiden, den entsprechenden Straßen und Hotelkomplexen). Ich sehe das allerdings als problematisch an, weil dann nur noch wenige von den Touristen profitieren. Das kann nicht die Lösung sein.

Auch die Kinder haben dieses Verhalten verinnerlicht. Beispielsweise kommen sie auf einen zu und sagen hallo und erhoffen sich sehr klar Geld von den Touristen. Eine Begegnung ist mir auch länger im Gedächtnis geblieben. Die Meisten Ägypter machen die übliche Geste, wenn sie Geld wollen (Zeigefinger und Daumen aneinander reiben). Ein kleines Mädchen in Kairo kurz vor Ende der Reise hat aber das Zeichen für Essen gemacht, die war geschätzt jünger als 10 Jahre alt.

Wenn Sie wirklich essen gebraucht hätte, würde ich nicht zögern ihr Geld zu geben. Aber nach über 10 Tagen negativer Erfahrungen ist man hinreichend skeptisch und kann leider überhaupt nicht mehr nachvollziehen was echt oder gespielt ist.

Das ist mein erster längerer Besuch in einem dritte Welt Land. Im Rahmen unserer Antarktistour waren wir zwar kurz in Chile, aber so viel wie in Ägypten haben wir nicht mitbekommen. Klar gibt es auch in den USA viele Bettler aber so krass wie in Ägypten sind die Unterschiede bei weitem nicht.

Das muss perse aus Sicht der Einheimischen nicht mal schlecht sein, denn in einfachen Verhältnissen Leben (auch wenn das nicht dem von Europäern gewohnten Lebensstandard entspricht), ist nicht grundsätzlich problematisch, wenn man mindestens Zugang zu Wasser und Nahrung in ausreichender Qualität und Menge hat.

Die Unterschiede sind Krass, es gibt Großbauten in den Hauptstädten und Bauten, die vom Pompösitätsniveau schon an das dritte Reich erinnern, aber die Leute leben nicht weit entfernt in Häusern, die diese Bezeichnung kaum verdienen. Generell sind Großstädte mit >20 Millionen Einwohnern natürlich selten schön und haben immer ihre Schattenseiten.

Davon ab war der Tag gesundheitlich beschissen. In der letzten Nacht hatte ich ab 3 Dauerdurchfall und diverse Toilettenbesuche. Unterdessen habe ich nicht mal mehr Appetit zum Abendessen, obwohl ich Mittags nichts gegessen habe.

Tag 7 – 11.03.2023:

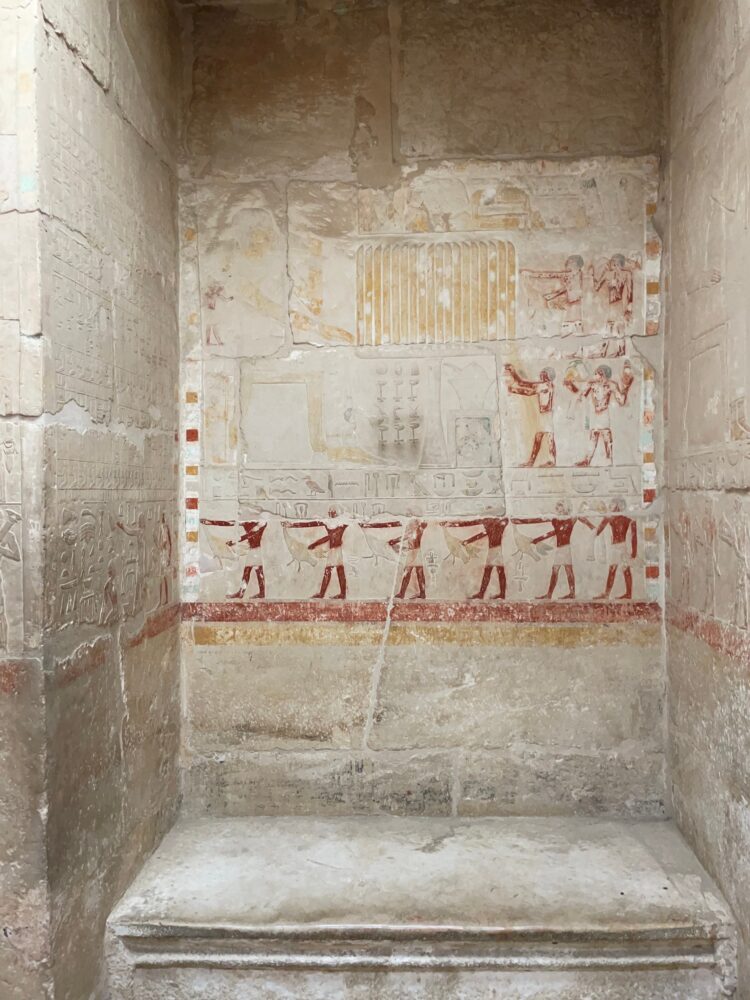

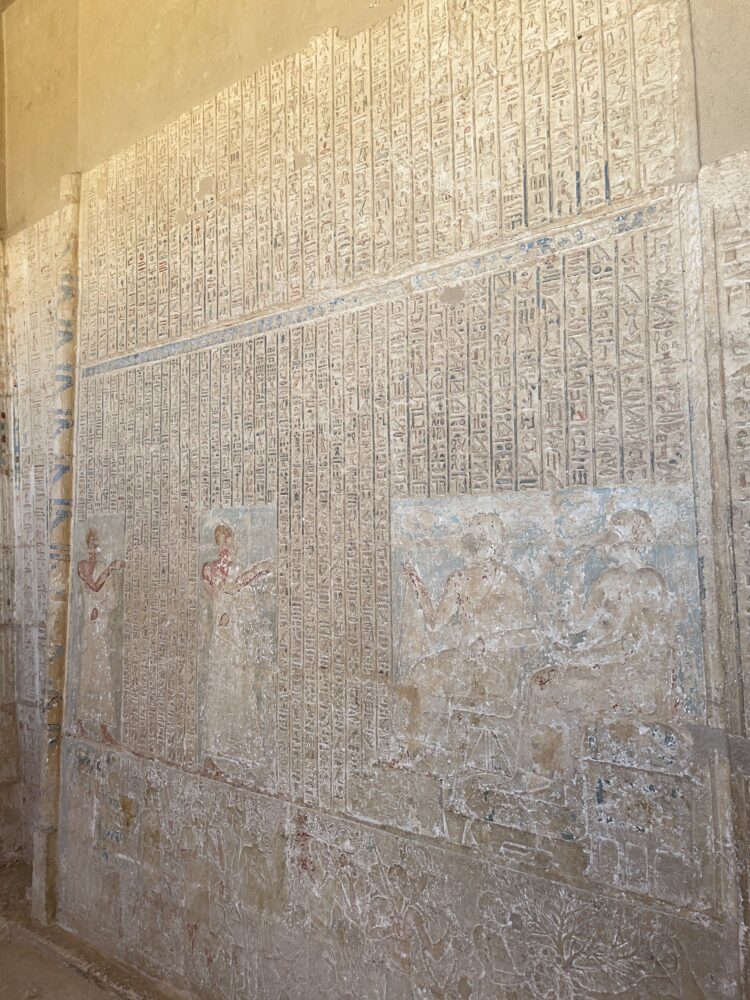

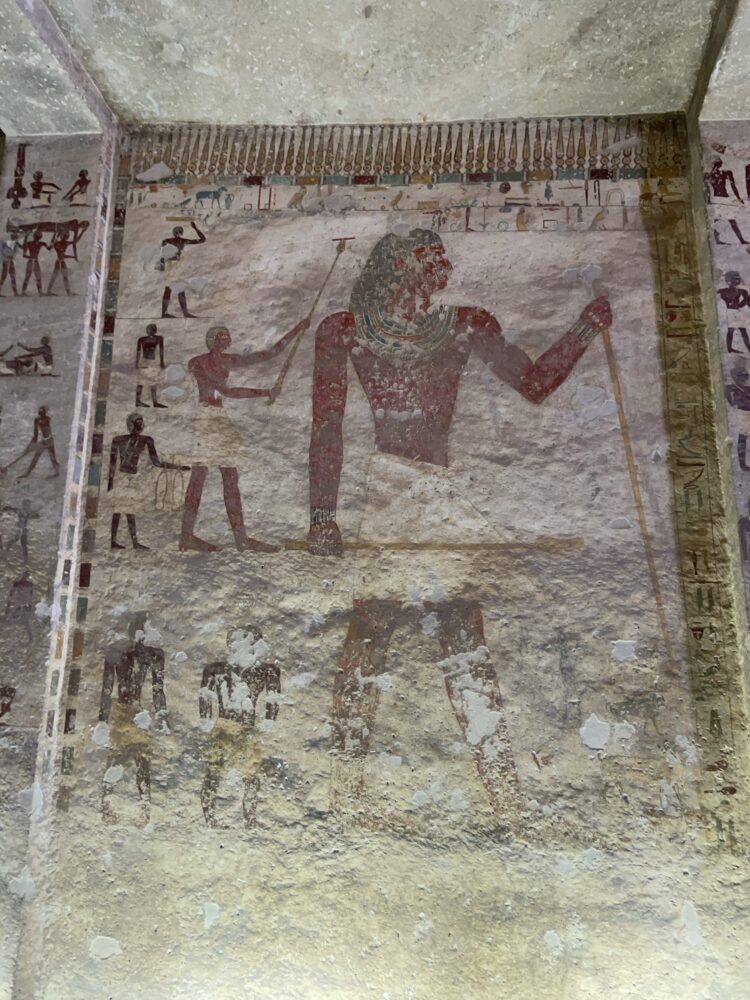

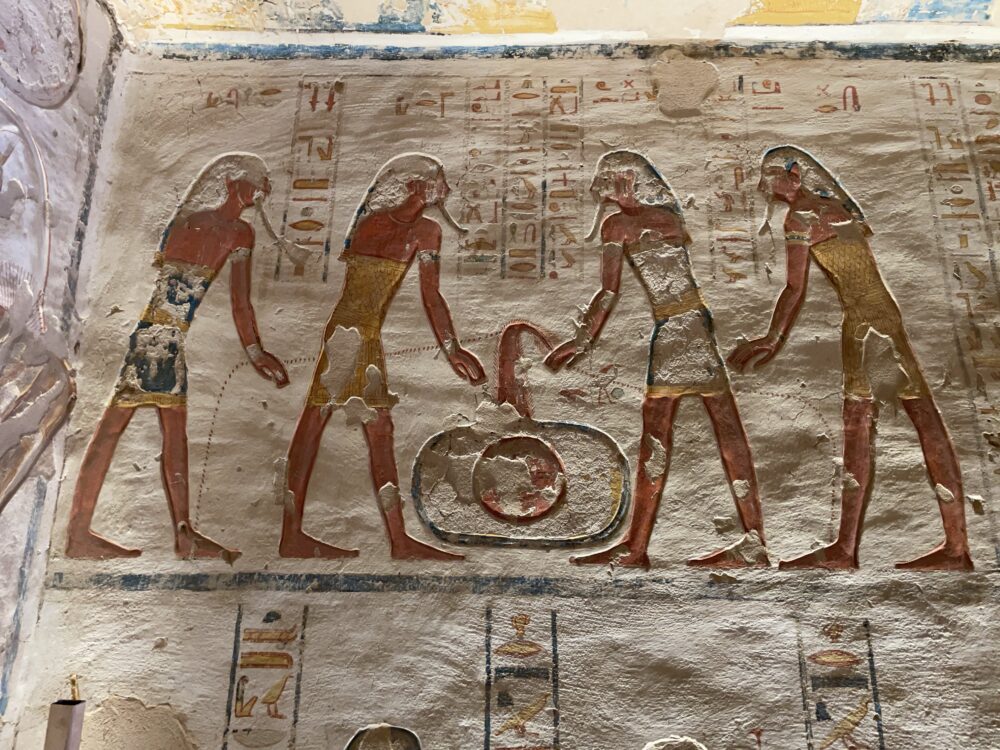

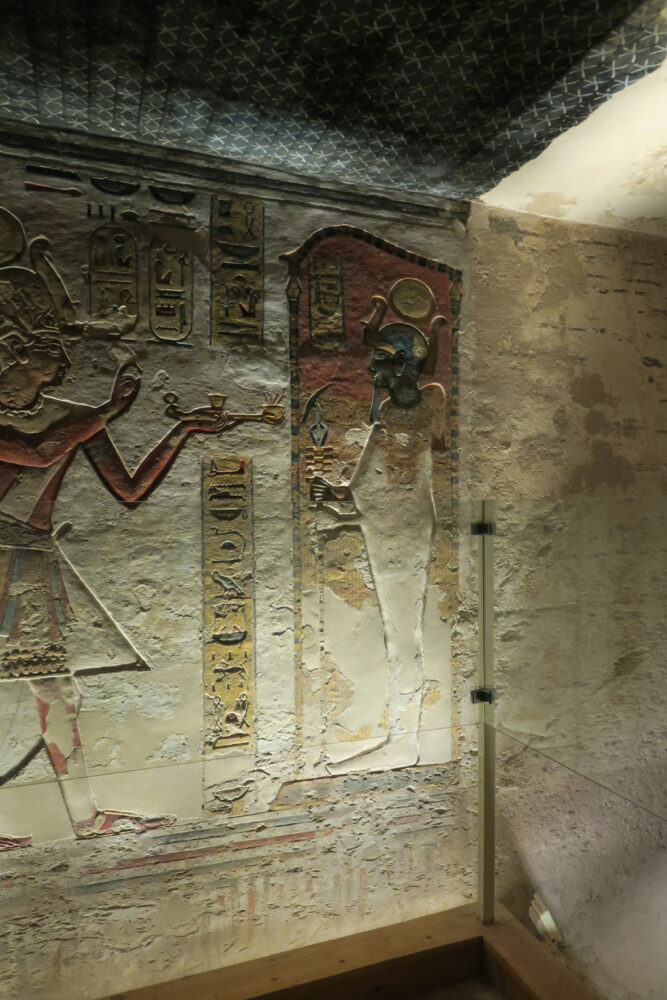

Heute geht es wieder um 7:30 los. Heute besichtigen wir lediglich Seti Temple at Abydos, der bisher neben den Pyramiden am beeindruckendsten ist.

Dummerweise sind unsere Launchpakete im anderen Bus gewesen und die werden uns per Taxi! hinterher gefahren. Somit verlieren wir ca. eine Stunde.

Unsere doppelte Polizeieskorte (im Bus und um den Bus) verlässt uns heute. Abends kommen wir in Luxor an.

Die Touristendichte in Luxor ist extrem viel höher als bisher auf der Tour, denn bisher waren wir eher an Orten wo nur sehr wenige Touristen waren.

Das Durchfallproblem bessert sich langsam wieder.

Tag 8 – 12.03.2023:

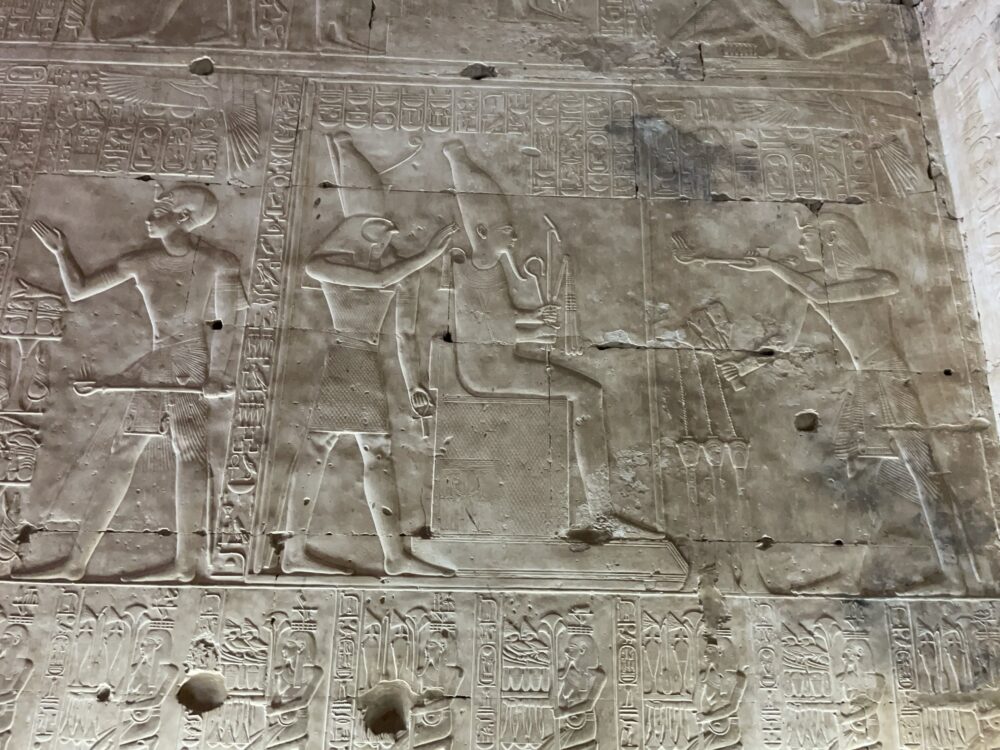

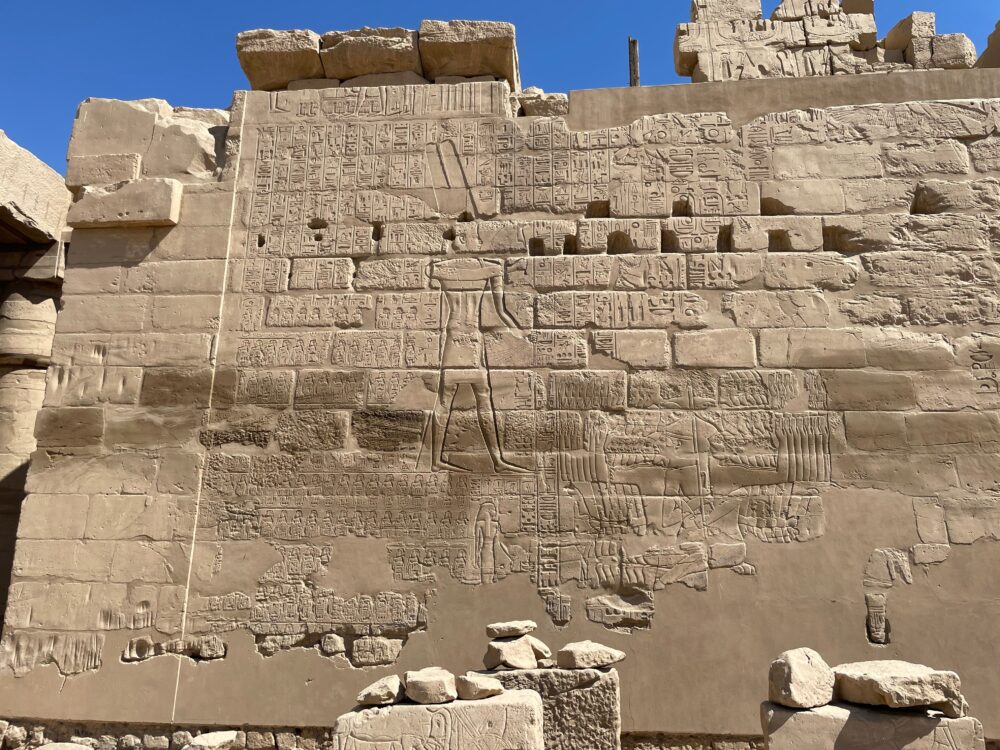

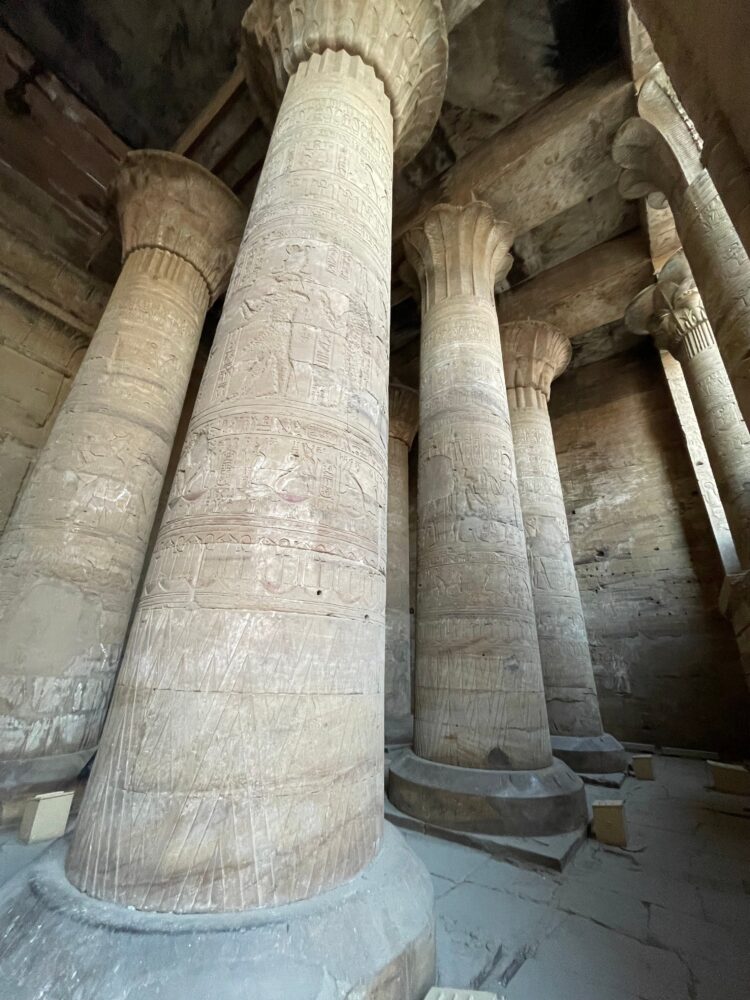

Heute geht es um 8:00 los. Zuerst besichtigen wir den Karnak Temple und anschließend den Luxor Temple. Ersteren finde ich wegen des imposanten Säulensales am beeindruckendsten. Abends kommen wir in Assuan an.

Heute habe ich erkannt, dass eine baulich erzwungene Teilung von zwei Spuren als Konzept in Ägypten nicht funktioniert. Jeder fährt wo er will auch als Geisterfahrer. Das trifft sogar auf Busse und LKW zu. Jetzt verstehe ich auch so langsam warum in einige Straßen Reifenaufschlitzer integriert sind, wenn man in die falsche Richtung fährt. Anders lernen es die Ägypter offenbar nicht.

Tag 9 – 13.03.2023:

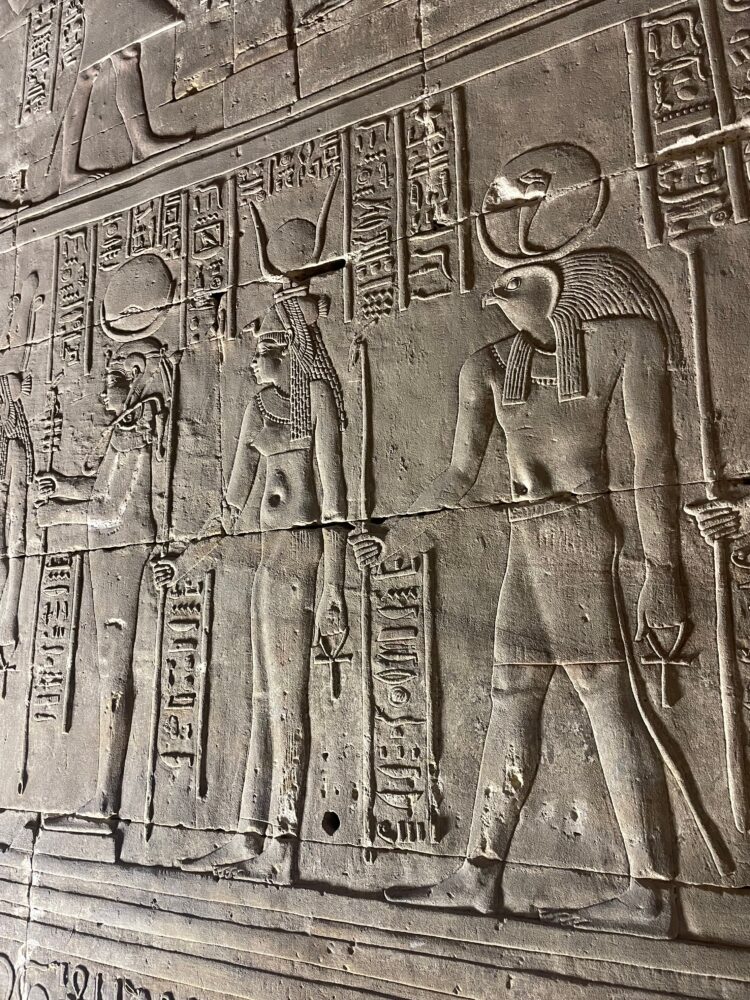

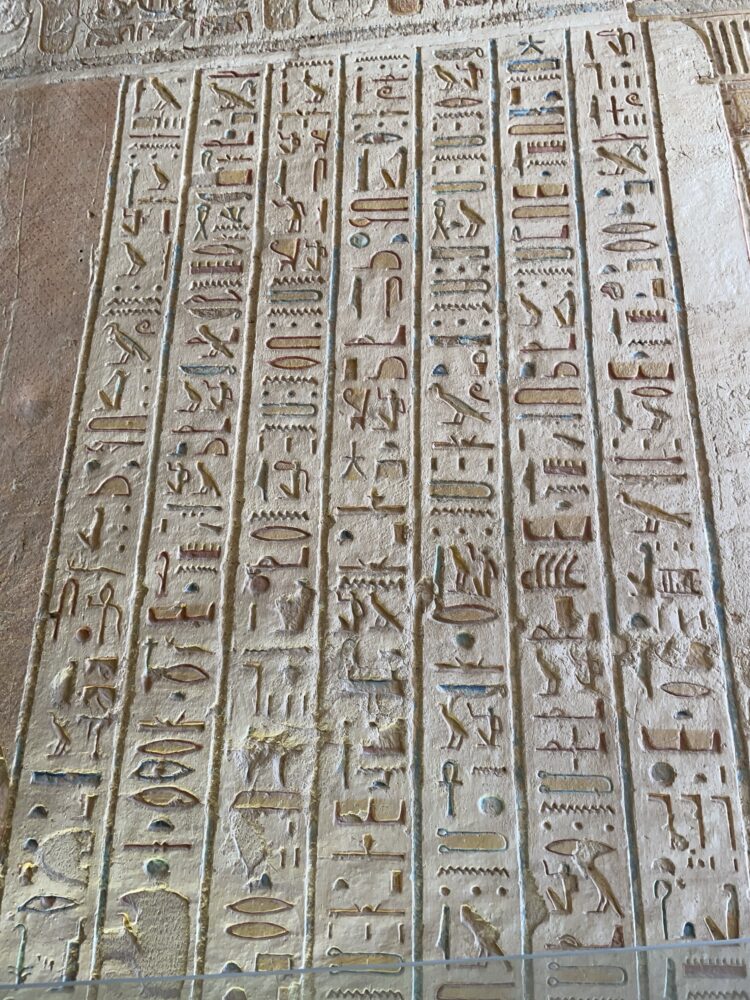

Heute geht es um 8:00 los. Zuerst schauen wir uns heute den unfinished Obelisk angesehen (ein Obelisk, der gerissen ist und somit im Steinbruch geblieben ist), anschließend den Assuan Staudamm und danach den Philae Temple. Gegen Mittag sind wir auf dem Schiff M/S Miriam eingetroffen. Der Nachmittag ist frei bis 16:00 wo es noch eine kleine Bootstour mit einem „Segelboot“ gibt. Das Boot als Boot zu bezeichnen finde ich schon etwas gewagt aber ok, dass entspricht Ägyptischen Standard. Mangels Wind können wir nicht segeln und werden von einem Motorboot (unser Boot hat keinen Motor) ein Stück den Fluss hochzogen und treiben anschließend mit der Strömung zurück.

Tag 10 – 14.03.2023:

Heute starten wir sehr früh (4:30) nach Abu Simbel. Dort kommen wir um 8:30 an und der Parkplatz ist voller Busse. Dass ist bisher der extremste Massentourismus in Ägypten. Die Tempel sind beeindruckend aber mit so vielen Menschen hat man nur bedingt etwas davon. Mittags sind wir zurück auf dem Schiff und fahren Richtung Kom Ombu zur Besichtigung.

Für die Abu Simbel Tour nimmt der Reiseveranstalter 150€ (das allein ist schon Megadreist bei der Preisgestaltung in Ägypten). Man kann weder per Kreditkarte zahlen, noch in Ägyptischen Pfund (obwohl die Kosten in Pfund anfallen). D.h. bei 14 Leuten die diese Tour buchen ist der Reingewinn für ägyptische Verhältnisse extrem. Für den Preis könnte man eher einen Flug erwarten.

Lohnt sich der Ausflug? Wenn man schon mal in Ägypten ist, sollte man Abu Simbel mal gesehen haben. Es ist aber extrem überlaufen. Alle Busse kommen morgens in etwa zur gleichen Zeit an und die Menschenmengen sind massiv.

Tag 11 – 15.03.2023:

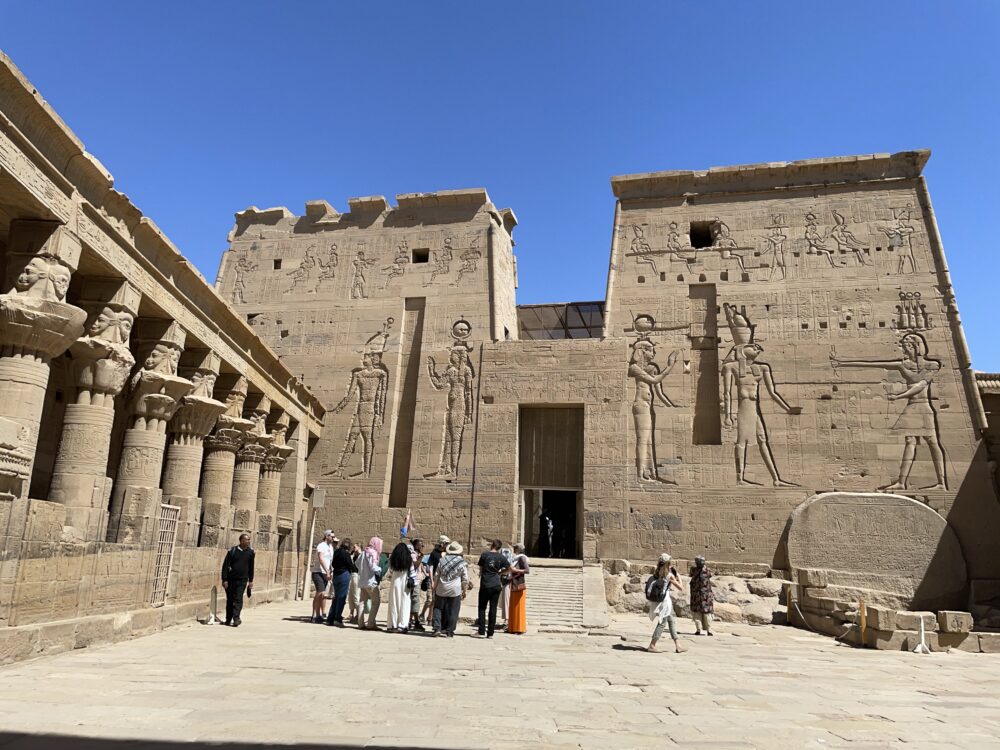

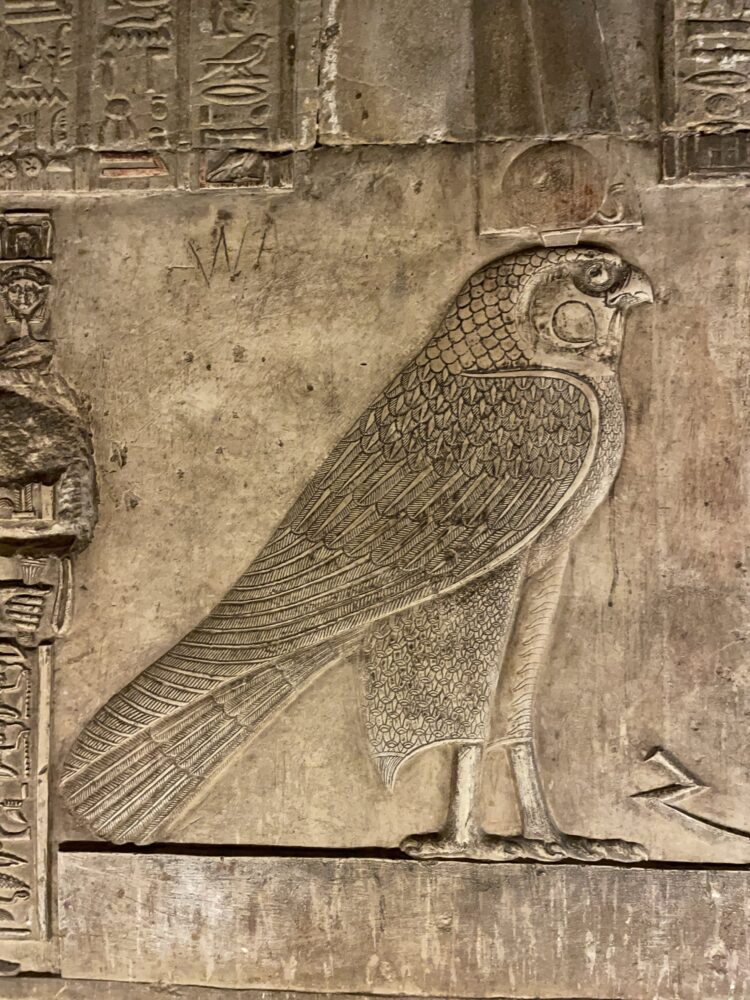

Heute starten wir um 5:30 und besichtigen in Edfu den Horustempel. Der Rest des Tages besteht aus einer Fahrt auf dem Nilschiff nach Luxor. Auf dem Weg passieren wir eine Schleuse. Entlang des Nils gibt es nicht viel zu sehen. Da hatte ich mit mehr gerechnet. Somit ist für mich auch klar, eine Nilkreuzfahrt kommt für mich nicht in Frage, die drei Tage reichen mir vollkommen aus.

Vor Händlern ist man übrigens auch auf Schiffen nicht sicher. Wie läuft das ab? Der Händler wirft ungefragt irgendwas auf das Schiff und entweder man wirft es zurück oder

Geld runter.

Tag 12 – 16.03.2023:

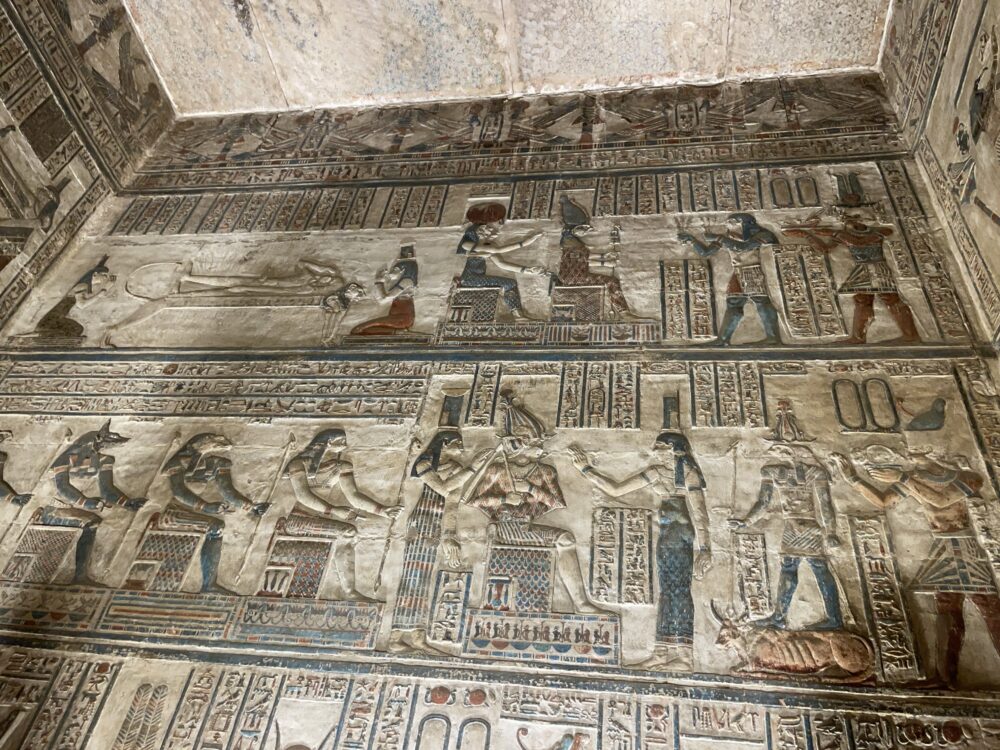

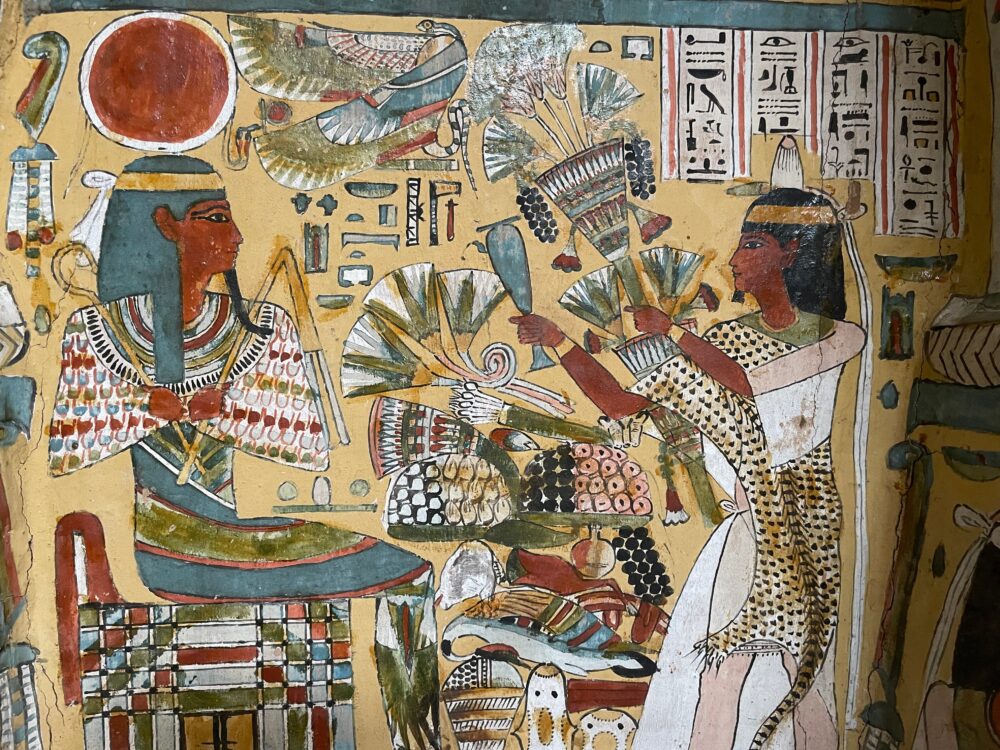

Heute fahren wir um 7:00 ab, besichtigen zwei Statuen, den Hatshepsut Temple, einen Steinmetz und das Tal der Könige. Wir besichtigen die Gräber von Ramses 7, Ramses 9 und Ramses 3. Abschließend besuchen wir den Dandarah Temple, bei dem die erste Halle extrem gut erhalten ist. Weiter geht es nach Hurghada. Die Option für das Seti Grab bietet der Reiseleiter nicht an.

Abends fahren wir nach Hurghada in eine All inclusive Anlage. Der Reiseführer sagt uns im Bus, dass dort „eine andere Art Touristen“ ist und das kann man so bestätigen. Ich würde nicht freiwillig eine oder zwei Wochen in so einer Anlage verbringen (vollkommen egal, ob in Ägypten oder andernorts), geschweige denn dafür bezahlen.

Zugegeben scheint unser Hotel oder Resort eher in die Kategorie günstig zu fallen aber derartiger Massentourismus (liege an Liege am Pool oder am Strand) war noch nie mein Ding. Aber essen und trinken kann man kostenlos von Morgens bis spät abends und für kleines Geld gibt es auch Cocktails, fall Bier und Softdrinks nicht reichen.

Tag 13 – 17.03.2023:

Um 10:00 starten wir, um zwei Kloster zu besichtigen.

Die beiden Kloster sind nicht wirklich sehenswert für meinen Geschmack. Man hätte Tag 13 und 14 zusammenlegen können um einen Tag schneller in Kairo zu sein.

Das Hotel Abends ist recht chaotisch. Wir sind so ziemlich die einzigen Gäste. Das erste Zimmer hat ein Queensizebett und die Zimmerzugangskarte geht nicht. Dann bekommen wir ein Zimmer in einem Trakt ohne Strom was uralt ist und das dritte Zimmer geht halbwegs – auch hier funktioniert der Türöffnungsmechnismus nur bedingt. Erstaunlich ist welche Essensmengen für ein paar Touristen aufgefahren werden. Für mich sieht das nach einem Familienbetrieb aus und sobald die Touristen weg sind, essen die einheimischen das gleiche Essen, anders machen solche Mengen keinen Sinn.

Tag 14 – 18.03.2023:

Heute starten wir um 10:00 Richtung Kairo. Das Programm besteht lediglich aus einem Basarrundgang und einer Pause in einem Cafe. Die letzten beiden Tage hätte man locker zu einem Tag kombinieren können. Nach einem Besuch im Nguib Mahfouz Café und einem Basarrundgang treffen wir um 15:30 in Hotel ein, wo die reguläre Tour endet.

Anschließend besuchen wir den Kairo Tower, wo wir ca. 30 Minuten warten bis wir hoch fahren dürfen. Es gibt nur einen Aufzug für 6 Leute und die Expresstickets und Restaurantbesucher werden bevorzugt behandelt. Dementsprechend sind die Wartezeiten schwer kalkulierbar. Ich hatte vorher von Wartezeiten bis zu mehreren Stunden gelesen, bin aber dann von Leuten beruhigt worden, die schon vor Ort waren. Faktisch würde ich beim nächsten Mal eher ein Expressticket kaufen, weil man wirklich mehrere Stunden warten kann, wenn man Pech hat.

Der Durchfall ist übrigens zurück.

Tag 15 – 19.03.2023:

Heute besuchen wir zuerst das Gayer Anderson Museum, der Besuch dauert weniger als eine Stunde. Wir bekommen auch eine Privatführung, die natürlich das berühmte Trinkgeld einfordert und uns relativ schnell durch das Haus bringt. Wie wir erfahren, wurde Teile eines der James Bond Filme (Roger More) in dem Haus gedreht.

Anschließend sind wir im Mumienmuseum NMEC was von außen zwar groß aussieht aber von innen sehr überschaubar ist. Das Museum lohnt sich zwar aber man ist erstaunlich schnell durch. Witzig ist die riesige Anlage, die überall abgesperrt ist oder es sitzt ein Polizist rum, der einem erklärt, dass man in diese Richtung nicht laufen darf (das betrifft sogar die Museumsumlage und die Parks). Das heißt in Ägypten gibt es viele Unsichtbare grenzen, die man Kennenlernt, sobald man sich vom Hauptpfad entfernt.

Das dritte Museum ist das Museum islamischer Kunst. Das ist auch überschaubar groß, hat aber einige interessante Exponate. Die Situation mit der Polizei ist vergleichbar drollig wie in dem anderen vorherigen Museum. Lt. Museumskarte benutze ich den Hauptausgang, den darf man aber als Tourist nicht benutzen, man muss den Ausgang ca. 30 Meter daneben benutzen. Auch hier wird die Polizei aktiv.

Als letztes besuchen wir das Manial Palace Museum, was ich am beeindruckendsten finde. Leider ist der Park weitgehend abgesperrt – diese Mal nicht von der Polizei, sondern nur mit Absperrband.

Die erste Fahrt morgens zum Gayer Anderson Museum machen wir mit dem Taxi (100 Pfund) – der Taxifahrer will gleich mit uns verhandeln und auch den ganzen Tag warten für 500 Pfund. Wir lehnen ab. Die folgenden mit Uber machen wir jeweils für 30-55 Pfund. Um 15:00 sind wir mit dem Programm durch.

Tag 16 – 20.03.2023:

Wir gehen um 9:00 mangels Alternativprogramm noch Mal in Ägyptische Museum, was allerdings vollkommen überlaufen ist. Wir besichtigen die Teile, die unser Tourguide beim Beginn der Tour ausgelassen hat. Da wir uns auf die weniger besuchten Teile konzentrieren können ist es halbwegs erträglich, aber nach etwas weniger als 2 Stunden sind wir durch und haben auch die Nase voll von solchen Touristenmassen.

13:00 Abholung Hotel und zurück nach Hause, wo wir gegen Abend um 23:00 eintrudeln. Dabei hatten wir den optimalen Flug. Die Reisegefährten sind teilweise in der Nacht des 15 Tages um 2:00 abgeflogen.

Allgemeines:

Lt. Tourguide scheint das Rentensystem in Ägypten nicht schlecht zu sein, der Nachteil ist wohl, dass jeder selbst entscheidet wie viel er für seine Rente zurücklegt. Man versichert das eigene Gehalt zu X% und die meisten Ägypter versichern nur einen geringen Anteil, um mehr Geld zum Leben zu haben, was sich später rächt.

Das Gesundheitssystem hat sehr viele Besonderheiten und Ausnahmen. Für zig Gruppen gibt es Sonderkrankenhäuser und irgendwelche Ausnahmen warum eine Regelung greift oder nicht greift. Zusammengefasst habe ich nach der Erklärung den Eindruck, dass man viel Vitamin B, Geld oder eine Kombination von beidem braucht für eine gute Versorgung. Das liegt unter anderem wohl daran, dass viele Ägyptische Ärzte ins Ausland gehen, weil sie dort mehr verdienen (was sich leicht mit einer gewissen Pflichtzeit regeln ließe, wenn man erfolgreich Medizin in Ägypten studiert hat).

Das Militär kontrolliert so ziemlich alles einschließlich des Straßenbaus. Entweder sehen das die Einheimischen wirklich nicht kritisch, oder sie sind nach dem Arabischen Frühling Mundtot gemacht worden. Faktisch finde ich es z.B. sehr bedenklich wie viel Polizei und Militär Ägypten hat und das die neue Hauptstadt komplett mit einer Mauer und Zugangstoren ausgestattet ist. Wer muss da noch an Filme wie Panem denken? Ein Ägyptischer Frühling mit diesen Voraussetzungen und einer vollständigen Internetüberwachung dürfte sehr kurz sein.

Ansonsten erklärt uns unser Guide wie viele Rechte die Frau hat und das Frauen bei einer Scheidung in der Regel das komplette Eigentum des Mannes bekommen, dass als Mitgift in die Hochzeit eingebracht wird (so heftig wie er auf dem Punkt rumreitet, hat er diesbezüglich ggf. Erfahrung). Lt. Guide entscheiden die Frauen, ob sie kein Kopftuch tragen, ein Kopftuch oder eine Vollverschleierung. Mein Eindruck: Das mag theoretisch so stimmen, aber in den Ägyptischen Familienverbünden wird das wohl sehr stark über das Elternhaus getriggert. Ägypterinnen ohne Kopftuch sehe ich wenige. Wenn doch, dass sind sie meist reich und eher in Städten zu treffen.

Lt. unserem Tourguide gibt es in Ägypten eine allgemeine Schulpflicht, lt. meinem letzten Stand ist die Analphabetenquote in Ägypten aber sehr hoch (30%). Die Zahl stammt allerdings aus 2006. Die öffentlichen Schulen in Ägypten haben teilweise so viele Schulkinder, dass lernen quasi unmöglich ist.

Unser Tourguide hat im Studium Hieroglyphen studiert. Zu Land und Leuten erzählt er sehr wenig. Am Tag 14 organisiert er auf Wunsch vor 10:00 einen Zusatzausflug, wobei er der Meinung ist, dass das nicht sein Job ist (ich sehe das anders, als Reiseleiter ist das sogar primär sein Job). Somit gibt es während der Tour massiv viele Informationen zu den Darstellungen in Gräbern und Tempeln aber recht wenig Informationen zu Land und Leuten oder ganz schlicht zum Tagesablauf. Die Tour hat also sehr stark den Charakter einer Studienreise, obwohl sie so nicht beschrieben wurde.

Essen gibt auf der Tour nur recht unregelmäßig. Ich habe glaube ich noch nie eine Tour gehabt, bei der so viele Malzeiten komplett ausgefallen sind. Selbst in Alaska gab es immer vorher die Info wo man nichts bekommt und wann man sich ggf. eine Kleinigkeit kaufen soll / kann. In Australien hatte der Tourguide immer Kleinigkeiten dabei, die man essen konnte.

Das gab es auf diese Tour überhaupt nicht (zwischendurch hatte der Tourguide mal ein paar Kleinigkeiten aber in sehr überschaubarer Menge und vollkommen unplanbar). Nicht das wir uns falsch verstehen, ich brauche definitiv keine großen Shoppingstops bei denen man den halben Tag verplempert aber ab und an mal an einer Tankstelle oder vergleichbaren halten mit der Info für dann und dann benötigt ihr dies oder jenes ist schon ok, finde ich. Wenn man eh schon Magensäureprobleme oder andere gesundheitliche Probleme hat, sind vollkommen unregelmäßige Essenszeiten auch nicht gerade förderlich. Ich kann zumindest sagen, dass die Reisegruppe, die wir in Alaska oder Schottland hatten, recht schnell rebelliert hätte bei derart unsteter Essensversorgung.

Der Straßenverkehr ist schwer zu beschreiben. Das muss man einfach gesehen haben. Schlimmer ist es wohl noch in Indien aber selbst in Ägypten ist es als Tourist teilweise schwierig über die Straße zu kommen. Es gibt dabei alles, einheimische die Bremsen, Leute die noch auf das Gas treten usw. – das Problem ist, dass man das System einfach nicht gewohnt ist.

Als generelle Regel kann man sagen, dass man gleichmäßig über die Straße gehen sollte, dann fließt der Verkehr an einem vorbei. Das gilt aber nicht pauschal und hängt von der Verkehrssituation und anderen Faktoren ab, Blickkontakt schadet auch nicht und im Zweifelsfall muss man auch mitten auf einer 5 spurigen Straße stehen bleiben und warten, während vor und hinter einem Autos mit 50 Sachen vorbei rauschen.

Ich habe selbst einheimische mit Hechtsprüngen von der Straße rennen sehen, weil irgendwer statt zu Bremsen auf das Gas getreten hat. Fußgängerampeln und Zebrastreifen kann man vergessen. Beides existiert in Ägypten zwar aber wir von niemanden beachtet (bzw. die Fußgängerampeln habe ich auch nirgendwo im Betrieb gesehen, es gab nur teilweise welche).

Somit war das der Erste Urlaub, bei dem ich nicht die Stadt zu Fuß erkundet habe, wie ich das eigentlich geplant hatte. Die 20 Straßenquerungen, die ich Kairo gemacht habe, teilweise über 5 spurige Straßen haben mir vollkommen gereicht.

Nachts fahren übrigens die wenigsten mit Licht durch die Gegend, obwohl viele funktionierende Scheinwerfer haben, die werden aber in der Regel nur für die Lichthupe benutzt. Auch nachts laufen die einheimischen über die Straße wie Tagsüber.

In ganz Ägypten laufen extrem viele wilde Katzen und Hunde durch die Gegend, die sich offenbar irgendwie durchschlagen können.

Fazit:

Ist Ägypten eine Reise wert? Durchaus. ein Top Reiseziel ist Ägypten für mich aber nicht. Denn die Sehenswürdigkeiten sind im Prinzip alle gleich. Es läuft auf Tempel, Gräber und die ehemaligen Inhalte von beiden in Museen heraus. Das merkt man auch an den Mitreisenden (mehrere waren schon an Orten wie der Antarktis, bevor sie nach Ägypten gereist sind), es geht also wohl nicht nur uns so, dass Ägypten nicht ganz oben auf der Liste stand.

Ob man – wie wir – eine zwei Wochen Tour machen muss? aus meiner Sicht sind die Hauptsehenswürdigkeiten in Luxor / Abu Simbel, Assuan und Kairo. Die Kloster hätte man sich sparen können und auch ein paar Tempel / Gräber am Anfang der Tour. Allerdings lernt man so auch mehr vom Land und Leuten kennen und bekommt einen realistischeren Eindruck.

Landschaftlich hat Ägypten nichts zu bieten. Das war mir grundsätzlich vorher bewusst aber so krass hätte ich das nicht erwartet. Zumindest entlang des Nils hatte ich mir etwas mehr gerechnet. Aufgrund der Wasserknappheit hat man in Ägypten die fixe Idee, dass man den Niel durchgehend befestigen und einbetonieren muss (wie das Wasser sparen soll, weiß ich nicht). D.h. der Niel wird zunehmend unattraktiver.

Dazu kommt in Ägypten das Gefühl, dass man wirklich überall über den Tisch gezogen werden soll, ungeachtet, ob vom Reiseveranstalter, dem Tourguide oder den Einheimischen.

Kulturell war die Reise auf jeden Fall interessant, ob nun vom Straßenverkehr, vom Glauben oder von den unterschiedlichen Handhabungen von vielen Dingen, war Ägypten mal was ganz anderes als ich bisher bei den eher westlich geprägten Ländern, die ich besucht habe gewohnt war.

Ansonsten sind die interessantesten Sehenswürdigkeiten in Ägypten vollkommen überlaufen. Das wird auch daran liegen, dass Ägypten noch immer verhältnismäßig günstig ist.